盖世汽车讯 随着人工智能的快速发展,自动驾驶、具身智能等无人系统不断在现实场景中得到推广和应用。作为获取信息的核心手段,视觉感知在这些智能系统中发挥着十分重要的作用。然而,如何在动态、多样化和不可预测的环境中实现高效、精准和稳健的视觉感知,仍是有待解决的难题。

(图片来源:清华大学)

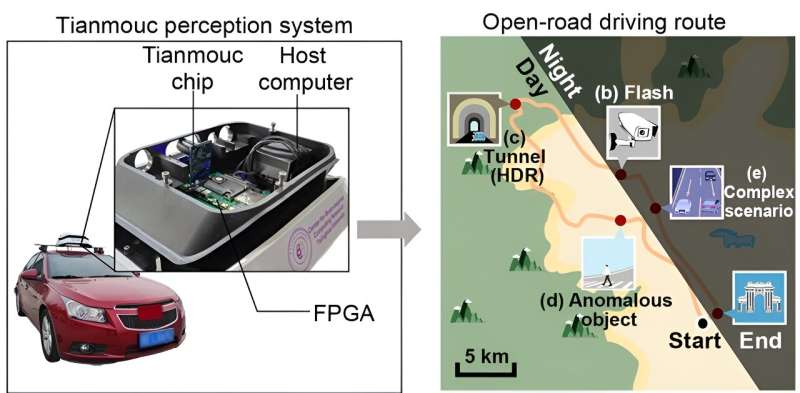

在开放世界场景中,智能系统不仅要处理大量数据,还要应对各种极端事件,如突发危险、隧道入口处剧烈的灯光变化,以及夜间驾驶场景中强烈的闪光干扰等。传统的视觉感知芯片受到“功耗墙”和“带宽墙”的限制,在处理这些场景时经常面临失真、故障或高延迟的问题,严重影响了系统的稳定性和安全性。

*特别声明:本文为技术类文章,禁止转载或大篇幅摘录!违规转载,法律必究。

本文地址:https://auto.gasgoo.com/news/202406/12I70395482C601.shtml

好文章,需要你的鼓励

联系邮箱:info@gasgoo.com

求职应聘:021-39197800-8035

简历投递:zhaopin@gasgoo.com

客服微信:gasgoo12 (豆豆)

新闻热线:021-39586122

商务合作:021-39586681

市场合作:021-39197800-8032

研究院项目咨询:021-39197921