盖世汽车讯 据外媒报道,密歇根大学工程学院(University of Michigan Engineering)的研究人员发明全新的软硬件协同设计方案,提高了人工智能(AI)的能效并降低了延迟,从而能够实时处理视频或传感器数据流等连续数据流。相关研究发表在期刊《Nature Communications》上,研究表明这种神经形态方法使得强大的实时AI可以直接在手机、助听器或自动驾驶汽车摄像头等本地边缘设备上运行。

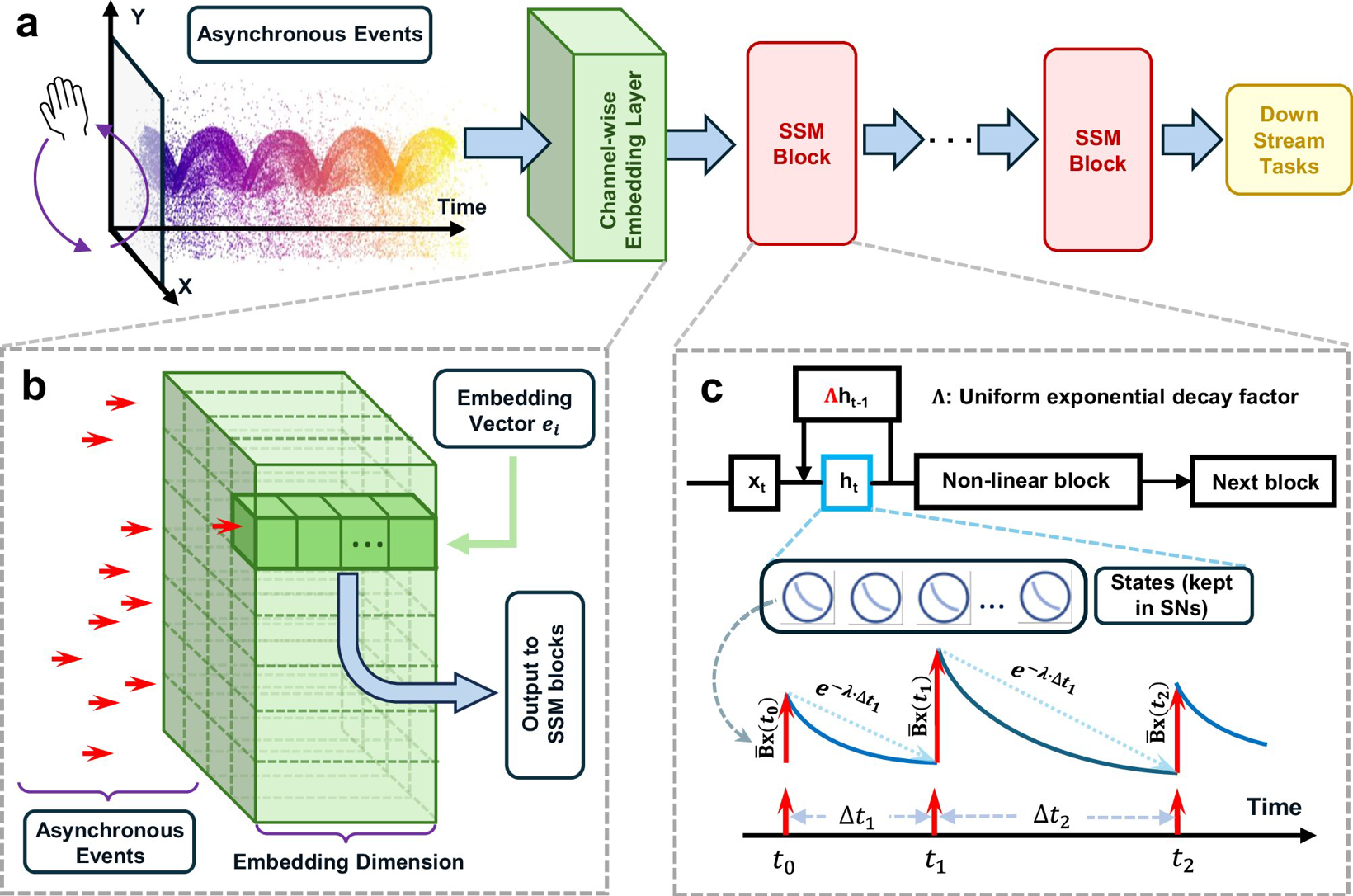

该研究团队首次将复杂的状态空间模型(一种替代ChatGPT等Transformer模型的尖端技术)直接映射到内存计算架构上。

图片来源:期刊《Nature Communications》

密歇根大学(U-M)James R. Mellor工程学教授、该研究的通讯作者Wei Lu表示:“内存计算系统具有极高的能效和吞吐量,但它们较为僵化,并非卷积神经网络和Transformer网络的最佳选择。在该研究中,我们证明了内存计算系统非常适合状态空间模型。状态空间模型中的所有操作都可以通过内存计算系统中的设备物理特性高效实现,这有望实现这些前景广阔的网络的高效硬件部署。”

AI处理效率问题

在边缘设备(例如智能手机、可穿戴健康监测器或自动驾驶汽车等电池供电设备)上运行AI推理,可以将数据本地化,从而提高速度、隐私性和效率。然而,目前的硬件和软件效率不足以在边缘设备上运行高级AI。

*特别声明:本文为技术类文章,禁止转载或大篇幅摘录!违规转载,法律必究。

本文地址:https://auto.gasgoo.com/news/202604/15I70453711C409.shtml

联系邮箱:info@gasgoo.com

求职应聘:021-39197800-8035

简历投递:zhaopin@gasgoo.com

客服微信:gasgoo12 (豆豆)

新闻热线:021-39586122

商务合作:021-39586681

市场合作:021-39197800-8032

研究院项目咨询:021-39197921