盖世汽车讯 为了在家庭环境、办公室和公共场所完成现实任务,机器人应该能够有效地抓取和操纵各种物体。近年来,开发人员创建了各种基于机器学习的模型,旨在使机器人能够熟练地操纵物体。

虽然其中一些模型取得了良好的效果,但为了表现良好,它们通常需要在大量数据上进行预训练。用于训练这些模型的数据集主要由视觉数据组成,例如带注释的图像和使用摄像机拍摄的视频片段,但有些方法也会分析其他感官输入,例如触觉信息。

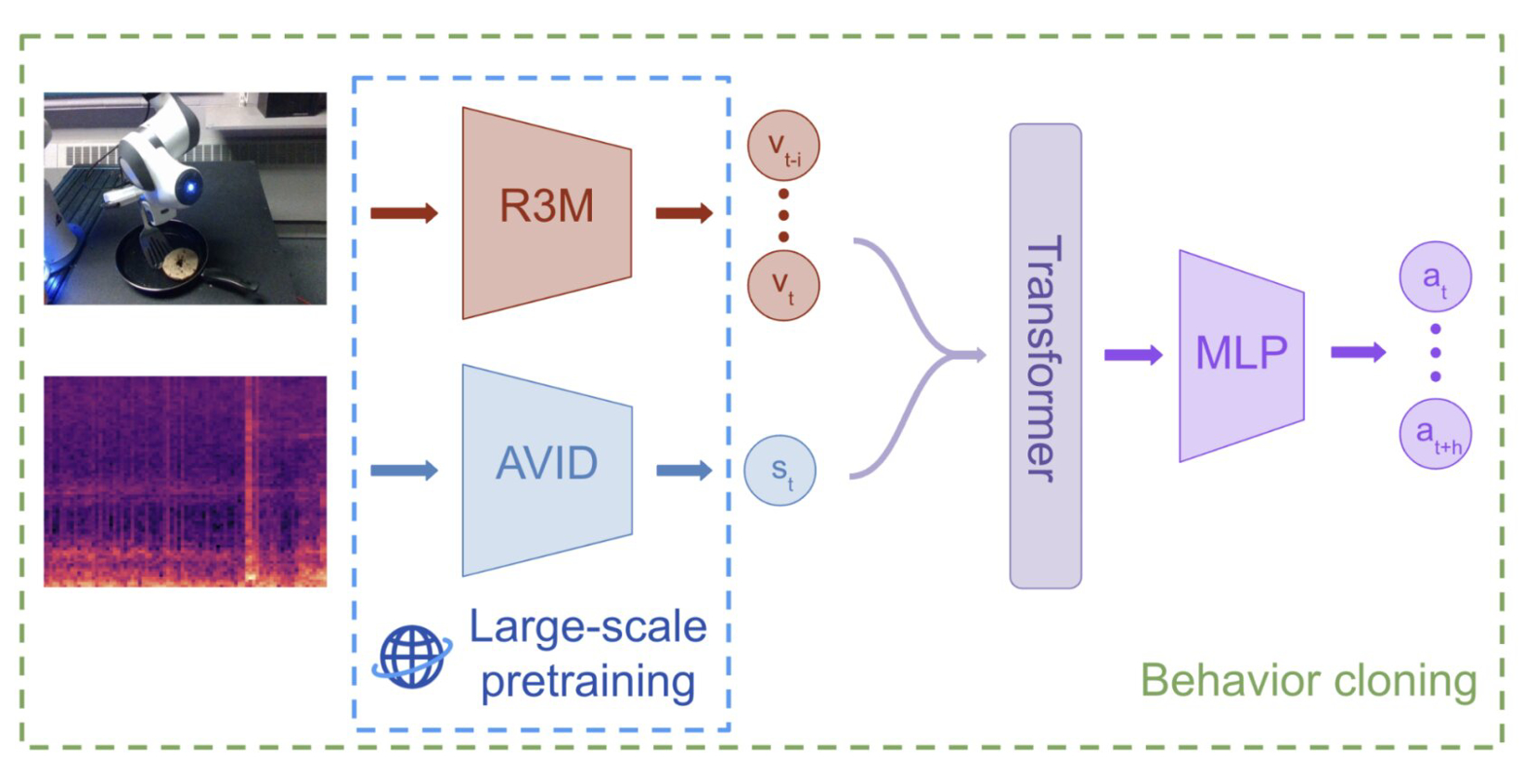

据外媒报道,卡内基梅隆大学(Carnegie Mellon University)和欧林工程学院(Olin College of Engineering)的研究人员最近探索使用接触式麦克风代替传统触觉传感器的可能性,从而能够使用音频数据来训练用于机器人操控的机器学习模型,可能为这些模型的大规模多感官预训练开辟新的机会。相关论文发表在arXiv预印本服务器上。

图片来源:卡内基梅隆大学

*特别声明:本文为技术类文章,禁止转载或大篇幅摘录!违规转载,法律必究。

本文地址:https://auto.gasgoo.com/news/202406/1I70394245C409.shtml

好文章,需要你的鼓励

联系邮箱:info@gasgoo.com

求职应聘:021-39197800-8035

简历投递:zhaopin@gasgoo.com

客服微信:gasgoo12 (豆豆)

新闻热线:021-39586122

商务合作:021-39586681

市场合作:021-39197800-8032

研究院项目咨询:021-39197921